EQS-News: Nota AI

/ Schlagwort(e): Produkteinführung

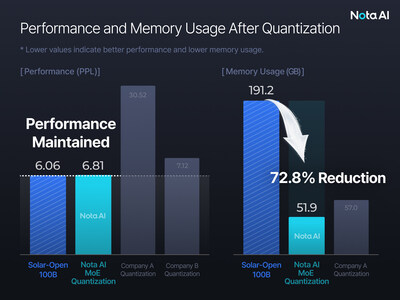

Der neue Ansatz "Nota AI MoE Quantization" erhält die Modellleistung und verbessert die Speichereffizienz deutlich SEOUL, Südkorea, 6. März 2026 /PRNewswire/ -- Nota AI, ein Unternehmen für KI-Optimierungstechnologie, gab bekannt, eine Quantisierungstechnologie der nächsten Generation entwickelt zu haben, mit der sich die Größe von Solar, einem von Upstage entwickelten leistungsstarken großen Sprachmodell (LLM), deutlich komprimieren lässt, ohne die hohe Genauigkeit zu beeinträchtigen. Dieser Durchbruch senkt die Inferenzkosten und erhöht die Verarbeitungsgeschwindigkeit, ohne Abstriche bei der Leistung.  Die Entwicklung wurde im Rahmen des "Sovereign AI Foundation Model Project" unter der Leitung des südkoreanischen Ministeriums für Wissenschaft und IKT durchgeführt. Durch den Einsatz der Verschlankungs- und Optimierungstechnologien von Nota AI bei Solar Open 100B verbesserte das Unternehmen die Speichereffizienz deutlich, ohne Einbußen bei der Modellleistung. Das Ergebnis senkt den Speicherbedarf des 100B-Parameter-Modells bei gleichbleibender Leistungsfähigkeit und ermöglicht einen praxisnäheren Einsatz koreanischer KI-Grundmodelle in Bereichen physischer KI wie Mobilität und Robotik. Die neu entwickelte Technologie konzentriert sich auf technische Herausforderungen im Zusammenhang mit der Mixture-of-Experts (MoE)-Architektur, die sich bei LLMs der nächsten Generation rasch durchsetzt. Herkömmliche Quantisierungsmethoden komprimieren in der Regel das gesamte Modell gleichmäßig, ohne die unterschiedlichen Eigenschaften der einzelnen Expertenmodelle zu berücksichtigen. Um diese Einschränkung zu überwinden, hat Nota AI einen firmeneigenen, für MoE-Architekturen optimierten Algorithmus namens "Nota AI MoE Quantization" entwickelt. Der Ansatz wurde entwickelt, um Quantisierungsverzerrungen während des Inferenzprozesses von MoE-Modellen zu minimieren. Im Gegensatz zu konventionellen Methoden, die über alle Operationen hinweg die Präzision gleichmäßig reduzieren, bewahrt der Algorithmus von Nota AI die Präzision in kritischen Komponenten, während er weniger empfindliche Teile des Modells komprimiert. Dies ermöglicht eine effektive Modellkomprimierung bei gleichzeitiger Minimierung der Leistungseinbußen. Die Anwendung der Technologie auf das Modell Solar 100B führte zu erheblichen Verbesserungen im Vergleich zu herkömmlichen Quantisierungsmethoden. Nota AI senkte den Speicherbedarf von Solar von 191,2 GB auf 51,9 GB, was einer Reduktion um 72,8 % entspricht. Gleichzeitig konnte das Modell ein mit der ursprünglichen Version vergleichbares Leistungsniveau beibehalten und erreichte einen Perplexitätswert (PPL) von 6,81, der nahe am Wert des Basismodells von 6,06 lag. Im Gegensatz dazu führten einige generische Quantisierungsansätze zu einer Leistungsverschlechterung um mehr als das Fünffache. Nota AI hat für diese Technologie eine Patentanmeldung eingereicht, um sein Portfolio an geistigem Eigentum zu stärken. Während herkömmliche Quantisierungstechniken oft Modellleistung opfern, um den Speicherbedarf zu senken, zeigt die Technologie von Nota AI, dass sich die Leistung erhalten lässt und zugleich KI-Dienste schneller sowie für mehr Nutzer mit begrenzten GPU-Ressourcen bereitgestellt werden können. Infolgedessen können Unternehmen große LLMs leichter auf eigenen Geräten bereitstellen - Modelle, die zuvor aufgrund von Hardwarebeschränkungen schwer umzusetzen waren. Die deutliche Verringerung des Speicherbedarfs von Solar 100B bei gleichbleibender Leistung eröffnet zudem neue Möglichkeiten, leistungsstarke KI in realen Einsatzumgebungen direkt auf Geräten bereitzustellen, etwa in Robotik- und Fahrzeugsystemen. Zusätzlich ermöglicht die Technologie Unternehmen mit begrenztem Zugang zu leistungsstarker GPU-Infrastruktur, mehr Nutzer auf derselben Hardware zu bedienen und so die Betriebskosten direkt zu senken. "Dieser Erfolg ist bedeutsam, weil wir die firmeneigene Quantisierungstechnologie von Nota AI auf Solar 100B, ein koreanisches KI-Grundmodell, anwenden und den Speicherbedarf bei gleichbleibender Leistung deutlich senken konnten", sagt Myungsu Chae, Geschäftsführer von Nota AI. "Da die Nachfrage wächst, große Modelle direkt auf Geräten bereitzustellen, werden die Verschlankungs- und Optimierungstechnologien von Nota AI eine entscheidende Rolle dabei spielen, leistungsstarke KI zu ermöglichen." Foto - https://mma.prnewswire.com/media/2926544/PR__Solar_NotaAI_260220.jpg

06.03.2026 CET/CEST Veröffentlichung einer Corporate News/Finanznachricht, übermittelt durch EQS News - ein Service der EQS Group. |

2286868 06.03.2026 CET/CEST